Subversion (SVN) ist nicht tot. Ganz im Gegenteil: Tausende Unternehmen, Behörden, Agenturen und Entwicklungsteams weltweit setzen täglich auf SVN als ihre zentrale Versionskontrolle. Doch während Git-Teams längst von Pull Requests, automatisierten Code-Reviews und KI-gestützten Analysen profitieren, stehen SVN-Teams oft vor einem überraschend großen Tooling-Defizit. Dieser Artikel erklärt, warum das so ist, warum die naheliegende Lösung – Cloud-basierte KI-Dienste – für viele Teams keine Option ist, und wie lokale KI-Modelle in Kombination mit einem nativen macOS-Tool dieses Problem endlich lösen.

Das vergessene Ökosystem: Warum SVN-Teams bei Code-Reviews leer ausgehen

Git hat in den letzten zehn Jahren ein enormes Ökosystem aufgebaut. GitHub, GitLab und Bitbucket bieten nicht nur Hosting, sondern auch eingebaute Code-Review-Workflows mit Pull Requests, Branch-Regeln, automatisierten Checks und mittlerweile sogar KI-gestützte Vorschläge. Jedes große IDE-Plugin, jede CI/CD-Pipeline und jedes DevOps-Tool ist primär für Git optimiert.

SVN-Teams operieren in einer völlig anderen Realität. Das zentrale Repository-Modell von SVN kennt kein natives Konzept für Pull Requests. Code wird direkt in den Trunk oder einen Branch committed, und ein Review findet – wenn überhaupt – erst nach dem Commit statt. Dedicated SVN-Review-Tools wie Crucible oder ReviewBoard existieren zwar, sind aber oft komplex einzurichten, erfordern Server-Infrastruktur und fühlen sich im Vergleich zu modernen Git-Workflows altmodisch an.

Das Ergebnis ist ernüchternd: In vielen SVN-Teams findet systematisches Code-Review schlicht nicht statt. Entwickler committen Änderungen direkt, und potenzielle Fehler, Stilverstöße oder Sicherheitslücken werden erst spät – oder nie – entdeckt. Das gilt besonders für kleinere Teams ohne dedizierte QA-Abteilung, bei denen jeder Entwickler primär an eigenem Code arbeitet und Reviews als „Luxus“ betrachtet werden.

Typische Probleme in SVN-Workflows ohne Reviews

- Fehlende Qualitätskontrolle: Ohne Review-Schritt landen Bugs, Copy-Paste-Fehler und inkonsistenter Code direkt im Repository.

- Wissenssilos: Nur der Autor kennt den Code. Wenn jemand das Team verlässt, bleibt unverständlicher Code zurück.

- Langsames Onboarding: Neue Teammitglieder haben keinen strukturierten Weg, die Codebase kennenzulernen und Feedback zu erhalten.

- Technische Schulden: Ohne regelmäßige Reviews häufen sich Inkonsistenzen und Architektur-Verstöße über Monate an.

- Kein Lerneffekt: Code-Reviews sind einer der effektivsten Wege, um als Entwickler zu lernen. Ohne sie stagniert das Teamniveau.

Das Cloud-Dilemma: Warum proprietärer Code nicht in die Cloud gehört

Die naheliegende Antwort auf das Review-Problem wäre: Nutze einfach ChatGPT, GitHub Copilot oder eine andere Cloud-KI. Lade den Code hoch, lass ihn analysieren, fertig. Für Open-Source-Projekte oder persönliche Projekte ist das ein gangbarer Weg. Für Unternehmen mit proprietärem Code ist es das oft nicht.

Wenn ein Entwickler Source Code an einen Cloud-Dienst sendet, verlassen die Daten die kontrollierte Umgebung des Unternehmens. Selbst wenn der KI-Anbieter verspricht, die Daten nicht für Training zu verwenden, gibt es mehrere ernsthafte Bedenken:

- Compliance und Regulierung: Branchen wie Finanzdienstleistungen, Gesundheitswesen, Verteidigung und öffentliche Verwaltung unterliegen strengen Datenschutzvorschriften (DSGVO, HIPAA, BSI-Grundschutz). Das Hochladen von Source Code kann gegen interne Richtlinien oder gesetzliche Anforderungen verstoßen.

- Geistiges Eigentum: Algorithmen, Geschäftslogik und proprietäre Implementierungen sind Kern-Assets eines Unternehmens. Jede Übertragung an Dritte birgt ein Risiko – unabhängig von den AGB des Anbieters.

- Unkontrollierte Datenflüsse: Selbst wenn der KI-Anbieter die Daten nicht speichert, durchlaufen sie Netzwerke, Load Balancer und Server-Infrastruktur, die außerhalb der Kontrolle des Unternehmens liegen.

- Vertragsklauseln: Viele Unternehmensverträge mit Kunden enthalten explizite NDA-Klauseln, die das Teilen von Code mit Dritten untersagen – auch mit KI-Diensten.

Das Kernproblem: SVN-Teams brauchen moderne Code-Review-Tools, dürfen aber häufig keinen Code in die Cloud senden. Diese Kombination macht lokale KI-Modelle zur einzigen vernünftigen Lösung.

Subversion (SVN) is not dead. Quite the opposite: thousands of companies, government agencies, creative firms, and development teams worldwide rely on SVN as their central version control system every single day. Yet while Git teams have long enjoyed pull requests, automated code reviews, and AI-powered analysis tools, SVN teams face a surprisingly large gap in modern tooling. This article explains why that gap exists, why the obvious solution – cloud-based AI services – is not an option for many teams, and how local AI models combined with a native macOS tool finally solve this problem.

The Forgotten Ecosystem: Why SVN Teams Miss Out on Code Reviews

Git has built an enormous ecosystem over the past decade. GitHub, GitLab, and Bitbucket offer not just hosting but also built-in code review workflows with pull requests, branch rules, automated checks, and by now even AI-powered suggestions. Every major IDE plugin, every CI/CD pipeline, and every DevOps tool is primarily optimized for Git.

SVN teams operate in an entirely different reality. SVN's central repository model has no native concept of pull requests. Code is committed directly to trunk or a branch, and reviews – if they happen at all – take place after the commit. Dedicated SVN review tools like Crucible or ReviewBoard do exist, but they are often complex to set up, require server infrastructure, and feel dated compared to modern Git workflows.

The result is sobering: in many SVN teams, systematic code review simply does not happen. Developers commit changes directly, and potential bugs, style violations, or security vulnerabilities are discovered late – or never. This is especially true for smaller teams without a dedicated QA department, where each developer works primarily on their own code and reviews are seen as a luxury.

Common Problems in SVN Workflows Without Reviews

- No quality gate: Without a review step, bugs, copy-paste errors, and inconsistent code land directly in the repository.

- Knowledge silos: Only the author understands the code. When someone leaves the team, incomprehensible code stays behind.

- Slow onboarding: New team members have no structured way to learn the codebase and receive feedback.

- Technical debt: Without regular reviews, inconsistencies and architectural violations accumulate over months.

- No learning effect: Code reviews are one of the most effective ways for developers to grow. Without them, team skill levels stagnate.

The Cloud Dilemma: Why Proprietary Code Should Not Go to the Cloud

The obvious answer to the review problem would be: just use ChatGPT, GitHub Copilot, or another cloud AI. Upload the code, have it analyzed, done. For open-source projects or personal work, this is a viable path. For companies with proprietary code, it often is not.

When a developer sends source code to a cloud service, the data leaves the controlled environment of the organization. Even if the AI provider promises not to use the data for training, there are several serious concerns:

- Compliance and regulation: Industries like financial services, healthcare, defense, and government are subject to strict data protection regulations (GDPR, HIPAA, SOC 2). Uploading source code can violate internal policies or legal requirements.

- Intellectual property: Algorithms, business logic, and proprietary implementations are core assets of a company. Any transfer to third parties carries risk – regardless of the provider's terms of service.

- Uncontrolled data flows: Even if the AI provider does not store the data, it passes through networks, load balancers, and server infrastructure outside the company's control.

- Contractual clauses: Many enterprise contracts with clients contain explicit NDA clauses that prohibit sharing code with third parties – including AI services.

The core problem: SVN teams need modern code review tools but often cannot send code to the cloud. This combination makes local AI models the only sensible solution.

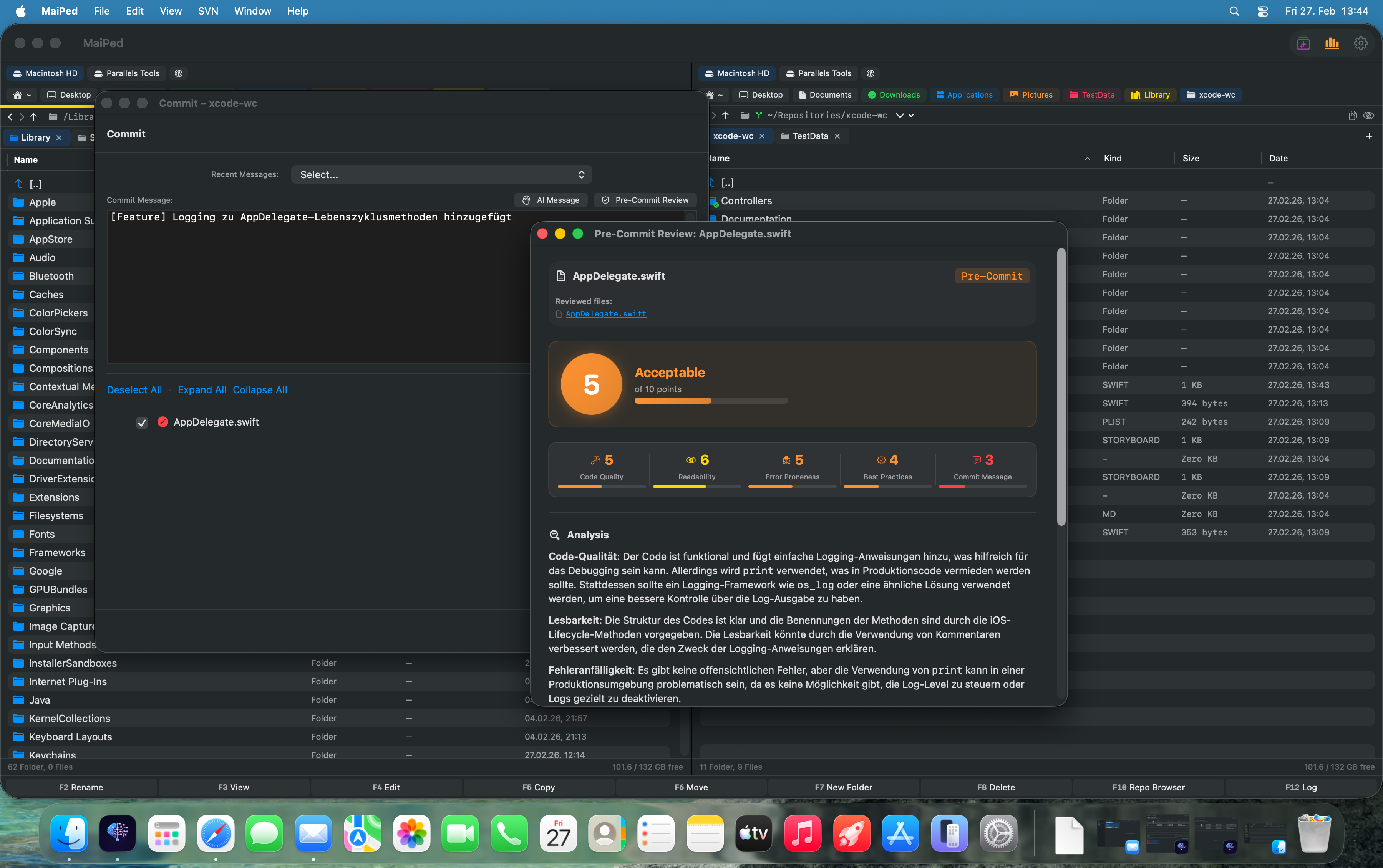

Das Code-Review-Panel zeigt Scores für Code-Qualität, Fehlerbehandlung, Performance und Dokumentation. The code review panel displays scores for code quality, error handling, performance, and documentation.

Die Lösung: Lokale KI-Modelle mit Ollama und LM Studio

Die gute Nachricht: Man muss im Jahr 2026 keinen Code mehr in die Cloud senden, um KI-gestützte Analysen zu nutzen. Dank Open-Source-Modellen und lokaler Inferenz-Software können leistungsfähige Sprachmodelle direkt auf dem eigenen Rechner laufen – ohne Internetverbindung, ohne Datenübertragung, ohne Datenschutzrisiko.

Ollama: KI im Terminal

Ollama ist eine schlanke Open-Source-Anwendung, die Large Language Models (LLMs) lokal auf macOS, Linux und Windows ausführt. Die Installation dauert weniger als eine Minute, und Modelle wie Llama 3, CodeLlama, Mistral, Phi-3 oder Qwen lassen sich mit einem einzigen Befehl herunterladen und starten. Ollama stellt eine lokale API bereit, die mit dem OpenAI-Format kompatibel ist – das bedeutet, jede Anwendung, die die OpenAI-API unterstützt, kann nahtlos auch mit lokalen Modellen arbeiten.

Für Code-Reviews eignen sich besonders Modelle wie CodeLlama 13B, Llama 3.1 8B oder Qwen 2.5 Coder, die speziell für Programmieraufgaben trainiert wurden. Auf einem modernen Mac mit Apple Silicon (M1 Pro oder besser) liefern diese Modelle Antworten in wenigen Sekunden – schnell genug für einen interaktiven Workflow.

LM Studio: Lokale KI mit grafischer Oberfläche

LM Studio bietet eine benutzerfreundliche Desktop-Anwendung zum Herunterladen, Konfigurieren und Ausführen von lokalen Modellen. Es verfügt über einen integrierten Modell-Browser, der direkt aus Hugging Face lädt, und einen lokalen Server-Modus, der ebenfalls eine OpenAI-kompatible API bereitstellt. Für Teams, die nicht mit dem Terminal arbeiten möchten, ist LM Studio oft der einfachere Einstieg.

Entscheidend ist: Sowohl Ollama als auch LM Studio laufen vollständig auf dem lokalen Rechner. Kein einziges Byte Code verlässt den Mac. Damit erfüllen sie automatisch jede Datenschutzanforderung – ob DSGVO, interne Compliance-Richtlinien oder vertragliche NDAs.

MaiPed: Lokale KI-Reviews direkt im SVN-Workflow

Lokale Modelle allein lösen nur die halbe Aufgabe. Was fehlt, ist die Integration in den täglichen SVN-Workflow: Ein Tool, das den Code kennt, der geändert wurde, ihn automatisch an das lokale Modell schickt, die Ergebnisse strukturiert darstellt und alles vor dem Commit passieren lässt. Genau das macht MaiPed.

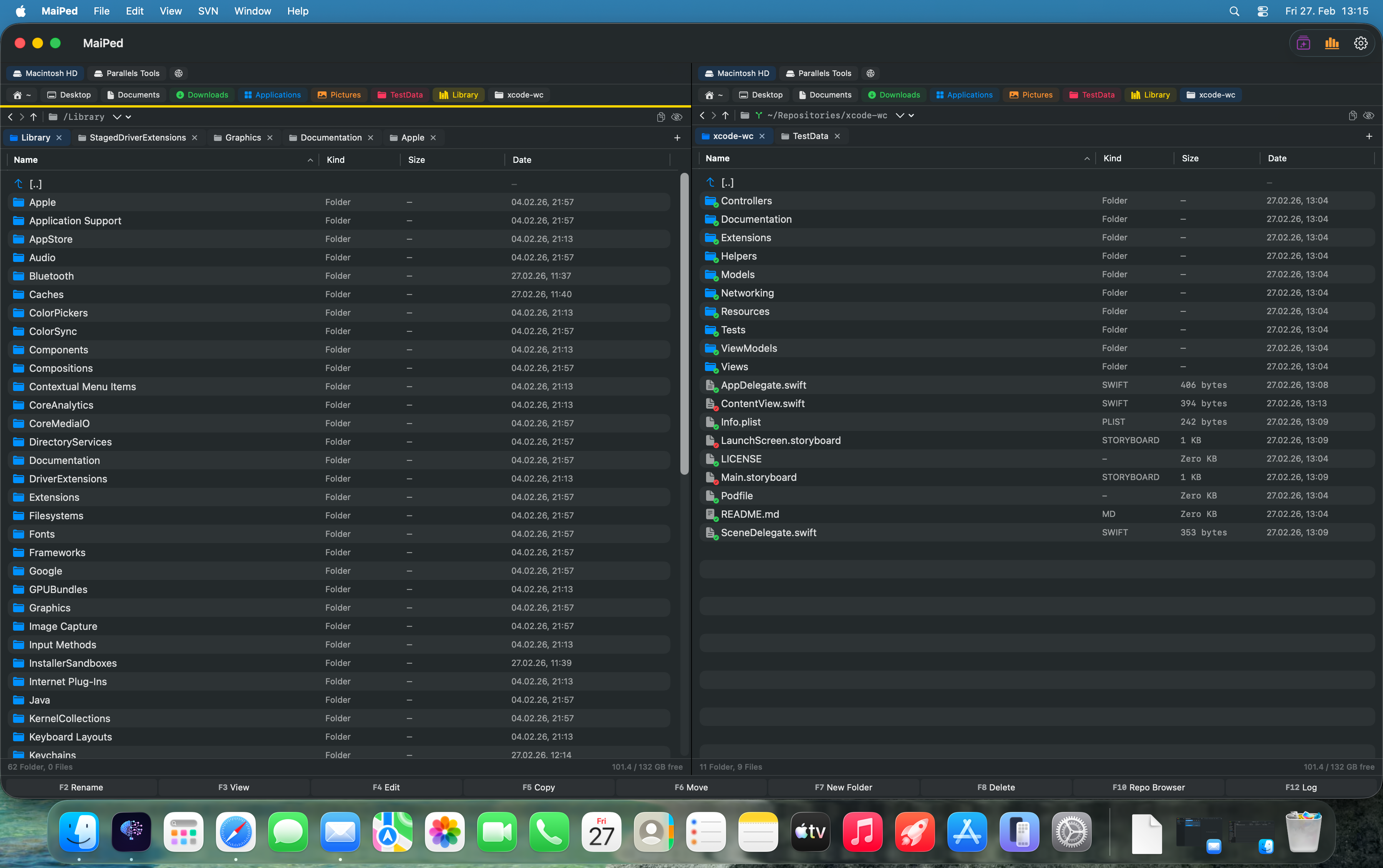

MaiPed ist ein nativer macOS Dual-Pane-Dateimanager mit integrierter SVN-Versionskontrolle und KI-gestützten Code-Reviews. Die App ist in SwiftUI gebaut, läuft nativ auf Apple Silicon und Intel, und kann komplett ohne Cloud-Dienste betrieben werden. SVN wird als gebundelte Binary mitgeliefert – es ist keine separate Installation nötig.

Pre-Commit Reviews mit Kategorie-Scores

Das Herzstück der Code-Review-Funktion ist das Pre-Commit Review. Bevor ein Entwickler Änderungen committed, kann er jede geänderte Datei durch eine KI-Analyse laufen lassen. MaiPed generiert dabei automatisch einen Diff der Änderungen, sendet diesen an das konfigurierte Modell (lokal oder cloud) und präsentiert die Ergebnisse in einem übersichtlichen Review-Panel.

Jedes Review umfasst vier Bewertungskategorien mit numerischen Scores von 1 bis 10:

The Solution: Local AI Models with Ollama and LM Studio

The good news: in 2026, you no longer need to send code to the cloud to benefit from AI-powered analysis. Thanks to open-source models and local inference software, powerful language models can run directly on your own machine – without an internet connection, without data transfer, without privacy risk.

Ollama: AI in the Terminal

Ollama is a lightweight open-source application that runs Large Language Models (LLMs) locally on macOS, Linux, and Windows. Installation takes less than a minute, and models like Llama 3, CodeLlama, Mistral, Phi-3, or Qwen can be downloaded and launched with a single command. Ollama provides a local API that is compatible with the OpenAI format – meaning any application that supports the OpenAI API can seamlessly work with local models as well.

For code reviews, models like CodeLlama 13B, Llama 3.1 8B, or Qwen 2.5 Coder are particularly well suited, as they were specifically trained for programming tasks. On a modern Mac with Apple Silicon (M1 Pro or better), these models deliver responses in a few seconds – fast enough for an interactive workflow.

LM Studio: Local AI with a GUI

LM Studio offers a user-friendly desktop application for downloading, configuring, and running local models. It features a built-in model browser that loads directly from Hugging Face and a local server mode that also provides an OpenAI-compatible API. For teams that prefer not to work with the terminal, LM Studio is often the easier entry point.

The crucial point: Both Ollama and LM Studio run entirely on the local machine. Not a single byte of code leaves the Mac. This automatically satisfies every privacy requirement – whether GDPR, internal compliance policies, or contractual NDAs.

MaiPed: Local AI Reviews Directly in the SVN Workflow

Local models alone only solve half the problem. What is missing is the integration into the daily SVN workflow: a tool that knows which code has changed, automatically sends it to the local model, presents the results in a structured way, and makes all of this happen before the commit. That is exactly what MaiPed does.

MaiPed is a native macOS dual-pane file manager with integrated SVN version control and AI-powered code reviews. The app is built in SwiftUI, runs natively on Apple Silicon and Intel, and can be operated entirely without cloud services. SVN is shipped as a bundled binary – no separate installation required.

Pre-Commit Reviews with Category Scores

The centerpiece of the code review feature is the pre-commit review. Before a developer commits changes, they can run every modified file through an AI analysis. MaiPed automatically generates a diff of the changes, sends it to the configured model (local or cloud), and presents the results in a clear review panel.

Each review covers four scoring categories with numerical scores from 1 to 10:

Jede Kategorie enthält nicht nur den numerischen Score, sondern auch eine textuelle Erklärung, was gut ist und was verbessert werden könnte. Das macht die Reviews nicht nur zu einem Qualitäts-Gate, sondern auch zu einem Lernwerkzeug – besonders für Junior-Entwickler, die so konkrete, nachvollziehbare Rückmeldung zu ihrem Code erhalten.

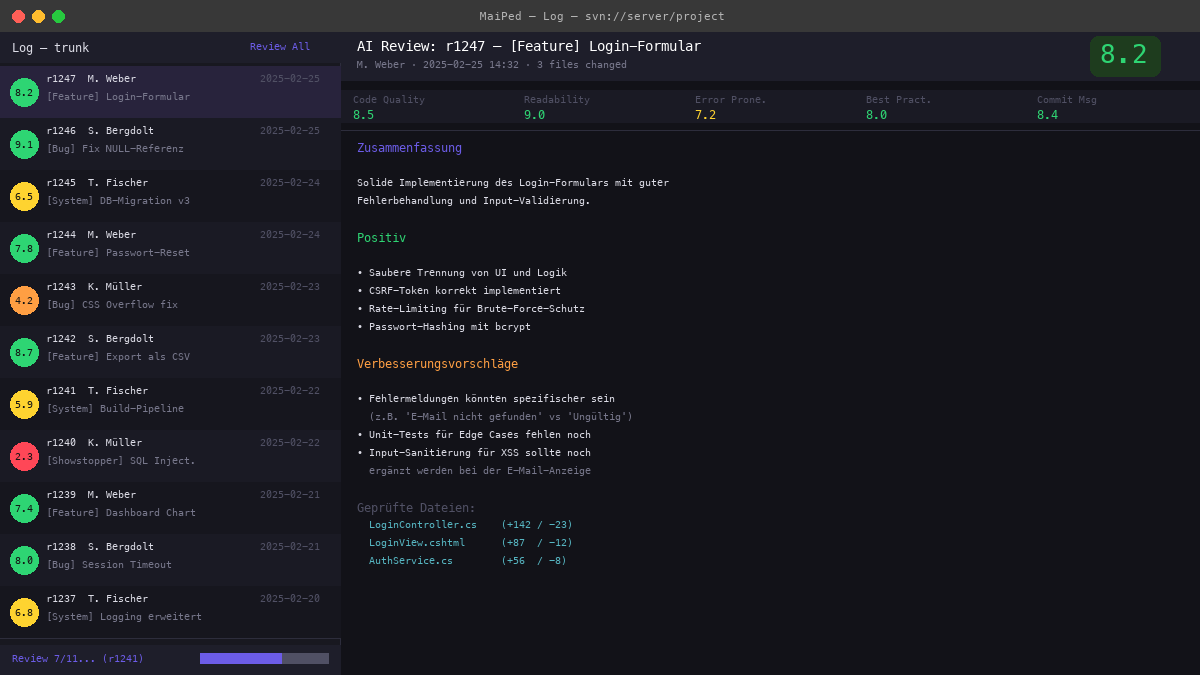

Batch-Reviews: Mehrere Dateien auf einmal

In der Praxis ändert ein Commit selten nur eine einzelne Datei. Typische Feature-Implementierungen oder Bugfixes betreffen drei, fünf oder zehn Dateien gleichzeitig. MaiPed unterstützt deshalb Batch-Reviews: Der Entwickler wählt alle geänderten Dateien aus, startet einen Batch-Review, und MaiPed analysiert jede Datei nacheinander. Die Ergebnisse werden in einer Übersicht zusammengefasst, sodass der Entwickler auf einen Blick sieht, wo die größten Probleme liegen.

Das ist besonders wertvoll, weil es den Workflow nicht unterbricht. Der Entwickler muss nicht jede Datei einzeln öffnen, den Diff manuell kopieren und in ein Chat-Fenster einfügen. Stattdessen ist der gesamte Prozess in den SVN-Workflow eingebettet: Änderungen sehen, Review starten, Feedback lesen, gegebenenfalls korrigieren, committen.

Each category contains not just the numerical score but also a textual explanation of what is good and what could be improved. This makes reviews not just a quality gate but also a learning tool – especially for junior developers who receive concrete, actionable feedback on their code.

Batch Reviews: Multiple Files at Once

In practice, a commit rarely touches just a single file. Typical feature implementations or bug fixes affect three, five, or ten files simultaneously. MaiPed therefore supports batch reviews: the developer selects all changed files, starts a batch review, and MaiPed analyzes each file sequentially. The results are summarized in an overview, so the developer can see at a glance where the biggest issues are.

This is particularly valuable because it does not interrupt the workflow. The developer does not have to open each file individually, manually copy the diff, and paste it into a chat window. Instead, the entire process is embedded in the SVN workflow: see changes, start review, read feedback, fix if needed, commit.

Alle geänderten Dateien eines Commits werden mit individuellen Kategorie-Scores bewertet. All changed files in a commit are scored individually across all categories.

Nahtlose Integration in den SVN-Workflow

Was MaiPed von generischen KI-Chat-Tools unterscheidet, ist die tiefe Integration in den SVN-Workflow. Die App ist nicht einfach ein Chat-Fenster, in das man Code einfügt – sie versteht den SVN-Kontext und nutzt ihn aktiv.

So sieht der typische Workflow aus

- Dateien bearbeiten: Der Entwickler arbeitet an seinem Code wie gewohnt. MaiPed zeigt im Dual-Pane-Commander den SVN-Status jeder Datei in Echtzeit an – geändert, hinzugefügt, gelöscht, in Konflikt.

- Review starten: Vor dem Commit wählt der Entwickler die geänderten Dateien aus und startet ein Pre-Commit Review. MaiPed generiert automatisch den SVN-Diff und sendet ihn an das konfigurierte KI-Modell.

- Feedback lesen: Die Review-Ergebnisse erscheinen im Review-Panel mit den vier Kategorie-Scores und detaillierten Erläuterungen. Kritische Punkte werden hervorgehoben.

- Korrekturen vornehmen: Der Entwickler kann direkt aus MaiPed heraus die Dateien öffnen, Korrekturen vornehmen und ein erneutes Review starten.

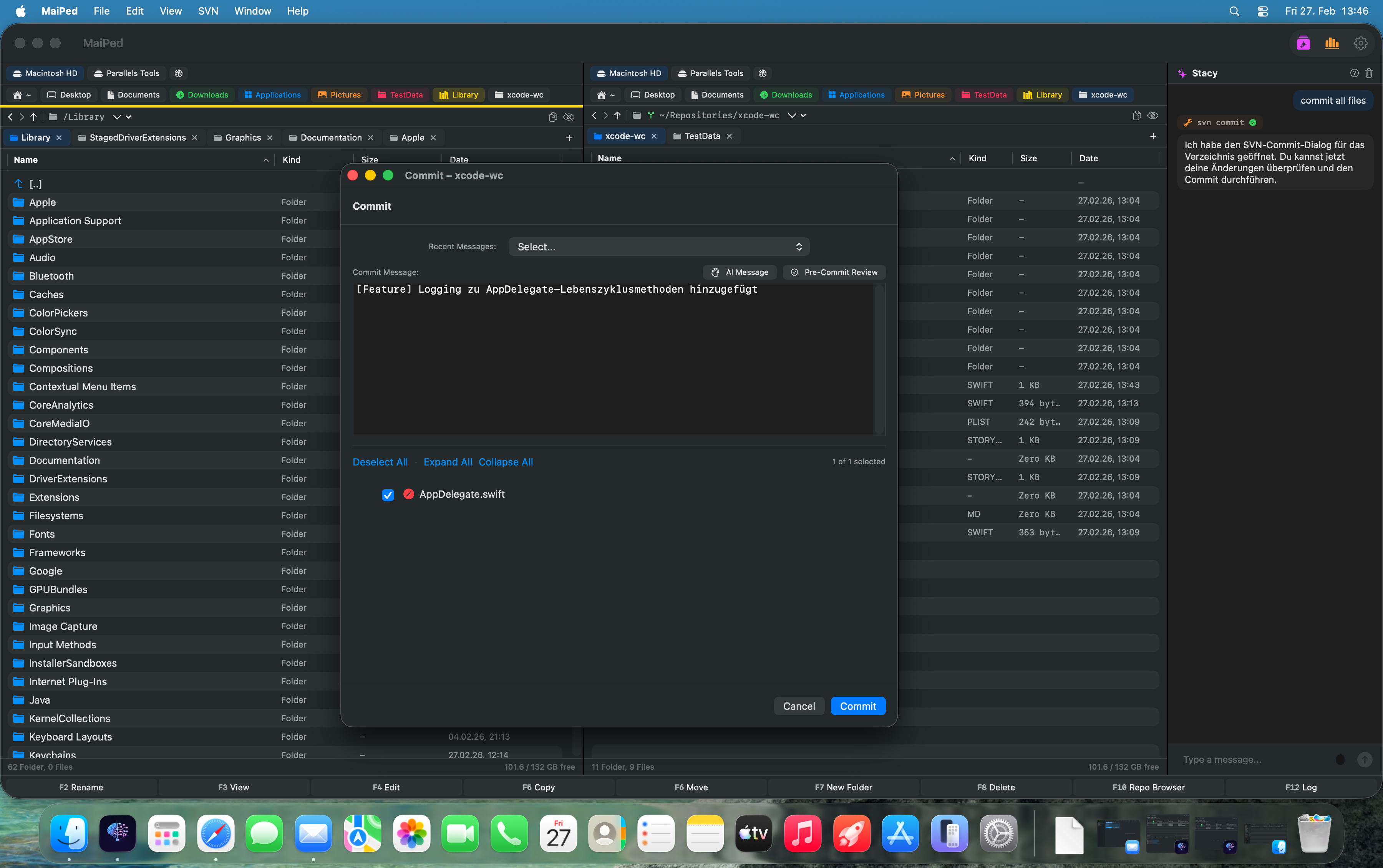

- Committen: Wenn die Scores zufriedenstellend sind, committed der Entwickler mit einer aussagekräftigen Commit-Nachricht – die übrigens auch von der KI generiert werden kann.

Dieser Workflow funktioniert mit jedem konfigurierten KI-Anbieter. Für maximalen Datenschutz nutzt man Ollama oder LM Studio als lokale Modelle. Für maximale Qualität kann man Cloud-Modelle wie GPT-4o, Claude 3.5 Sonnet oder Mistral Large verwenden. MaiPed unterstützt sogar unterschiedliche Anbieter für unterschiedliche Aufgaben – beispielsweise ein lokales Modell für Code-Reviews und ein Cloud-Modell für die KI-Assistentin StacyAI.

Unterstützte KI-Anbieter

Seamless Integration into the SVN Workflow

What sets MaiPed apart from generic AI chat tools is its deep integration into the SVN workflow. The app is not simply a chat window where you paste code – it understands the SVN context and actively uses it.

The Typical Workflow

- Edit files: The developer works on their code as usual. MaiPed displays the SVN status of each file in real time in the dual-pane commander – modified, added, deleted, conflicted.

- Start review: Before committing, the developer selects the changed files and starts a pre-commit review. MaiPed automatically generates the SVN diff and sends it to the configured AI model.

- Read feedback: The review results appear in the review panel with the four category scores and detailed explanations. Critical points are highlighted.

- Make corrections: The developer can open files directly from MaiPed, make corrections, and start a new review.

- Commit: When the scores are satisfactory, the developer commits with a meaningful commit message – which, incidentally, can also be generated by the AI.

This workflow works with any configured AI provider. For maximum privacy, use Ollama or LM Studio as local models. For maximum quality, you can use cloud models like GPT-4o, Claude 3.5 Sonnet, or Mistral Large. MaiPed even supports different providers for different tasks – for example, a local model for code reviews and a cloud model for the AI assistant StacyAI.

Supported AI Providers

Der Commander zeigt SVN-Status-Icons und ermöglicht Code-Reviews direkt aus dem Dateimanager heraus. The Commander shows SVN status icons and enables code reviews directly from the file manager.

Praktischer Nutzen: Was lokale KI-Reviews im Alltag bringen

Die Theorie klingt überzeugend, aber was bringt das in der Praxis? Aus der Erfahrung mit realen SVN-Workflows ergeben sich mehrere konkrete Vorteile, die den täglichen Entwicklungsalltag spürbar verbessern.

1. Bugs vor dem Commit finden

Der offensichtlichste Vorteil: Die KI findet potenzielle Fehler, bevor sie im Repository landen. Das betrifft nicht nur offensichtliche Syntaxfehler, sondern insbesondere logische Probleme, die ein Compiler nicht erkennt. Fehlende Null-Checks, unbehandelte Edge-Cases, potenzielle Race Conditions, falsch eingesetzte Vergleichsoperatoren oder vergessene Return-Statements – die KI analysiert den Code im Kontext und weist auf Risiken hin, die beim schnellen Durchlesen leicht übersehen werden.

In einem SVN-Workflow ohne Pull Requests ist das besonders wertvoll, weil es keinen zweiten Entwickler gibt, der den Code vor dem Commit sieht. Das KI-Review übernimmt diese Rolle und agiert als automatischer Code-Reviewer, der niemals müde wird, nie abgelenkt ist und jeden Commit mit der gleichen Gründlichkeit prüft.

2. Coding-Standards durchsetzen

Jedes Team hat (oder sollte haben) Coding-Standards: Namenskonventionen, Fehlerbehandlungsmuster, Dokumentationsanforderungen, Architekturregeln. In der Praxis werden diese Standards häufig nicht eingehalten – nicht aus bösem Willen, sondern weil unter Zeitdruck die Disziplin nachlässt und es keinen automatischen Prüfmechanismus gibt.

KI-Reviews können diese Lücke schließen. Die Kategorie „Code-Qualität“ bewertet Konsistenz, Namensgebung und Strukturierung. Die Kategorie „Dokumentation“ prüft, ob der Code ausreichend kommentiert ist. So entsteht ein automatisches Feedback-System, das Entwickler sanft, aber stetig in Richtung besserer Coding-Praktiken drängt – ohne dass ein menschlicher Reviewer seine Zeit investieren muss.

3. Junior-Entwickler schneller einarbeiten

Für Junior-Entwickler sind Code-Reviews der wichtigste Lernmechanismus. Sie lernen nicht nur, was funktioniert, sondern auch warum bestimmte Ansätze besser sind als andere. In Teams ohne systematische Reviews fehlt dieses Feedback fast vollständig.

KI-Reviews bieten hier einen entscheidenden Vorteil: Sie liefern sofortiges, detailliertes Feedback zu jedem Commit. Ein Junior-Entwickler kann seinen Code schreiben, das Review lesen, verstehen, was die KI vorschlägt, den Code verbessern und erneut reviewen lassen – alles in wenigen Minuten und ohne einen Senior-Entwickler zu blockieren. Das beschleunigt das Onboarding erheblich und baut systematisch Kompetenzen auf.

4. Technische Schulden reduzieren

Technische Schulden entstehen nicht über Nacht. Sie akkumulieren sich langsam, Commit für Commit, wenn kleine Inkonsistenzen, fehlende Dokumentation und suboptimale Lösungen sich unbemerkt anhäufen. Regelmäßige KI-Reviews machen diese schleichende Verschlechterung sichtbar und adressierbar. Wenn jeder Commit eine Bewertung erhält, entwickelt das Team ein Bewusstsein für Codequalität – und der Anreiz, sauberen Code zu schreiben, steigt.

5. Commit-Nachrichten automatisch generieren

Ein oft unterschätzter Aspekt: MaiPed kann nicht nur Code reviewen, sondern auch automatisch Commit-Nachrichten aus den Diffs generieren. Die KI analysiert die Änderungen und formuliert eine prägnante, aussagekräftige Nachricht – auf Deutsch oder Englisch. Das spart nicht nur Zeit, sondern führt auch zu konsistenteren und informativeren Commit-Logs.

Practical Benefits: What Local AI Reviews Deliver in Daily Work

The theory sounds compelling, but what does it deliver in practice? Based on experience with real SVN workflows, there are several concrete advantages that noticeably improve daily development work.

1. Catch Bugs Before Commit

The most obvious benefit: the AI finds potential bugs before they land in the repository. This applies not only to obvious syntax errors but especially to logical problems that a compiler cannot detect. Missing null checks, unhandled edge cases, potential race conditions, misused comparison operators, or forgotten return statements – the AI analyzes the code in context and points out risks that are easily overlooked during a quick read-through.

In an SVN workflow without pull requests, this is particularly valuable because there is no second developer who sees the code before the commit. The AI review takes on this role, acting as an automatic code reviewer that never gets tired, is never distracted, and checks every commit with the same thoroughness.

2. Enforce Coding Standards

Every team has (or should have) coding standards: naming conventions, error handling patterns, documentation requirements, architecture rules. In practice, these standards are frequently not followed – not out of malice, but because discipline slips under time pressure and there is no automatic enforcement mechanism.

AI reviews can close this gap. The code quality category evaluates consistency, naming, and structure. The documentation category checks whether the code is adequately commented. This creates an automatic feedback system that gently but steadily pushes developers toward better coding practices – without a human reviewer having to invest their time.

3. Onboard Junior Developers Faster

For junior developers, code reviews are the most important learning mechanism. They learn not only what works, but also why certain approaches are better than others. In teams without systematic reviews, this feedback is almost entirely absent.

AI reviews offer a decisive advantage here: they provide immediate, detailed feedback on every commit. A junior developer can write their code, read the review, understand what the AI suggests, improve the code, and have it reviewed again – all within minutes and without blocking a senior developer. This significantly accelerates onboarding and systematically builds competencies.

4. Reduce Technical Debt

Technical debt does not appear overnight. It accumulates slowly, commit by commit, as small inconsistencies, missing documentation, and suboptimal solutions pile up unnoticed. Regular AI reviews make this gradual deterioration visible and addressable. When every commit receives a score, the team develops an awareness of code quality – and the incentive to write clean code increases.

5. Auto-Generate Commit Messages

An often underestimated aspect: MaiPed can not only review code but also automatically generate commit messages from diffs. The AI analyzes the changes and formulates a concise, informative message – in German or English. This not only saves time but also leads to more consistent and informative commit logs.

StacyAI analysiert den Diff und schlägt eine prägnante Commit-Nachricht vor. StacyAI analyzes the diff and suggests a concise commit message.

Warum gerade SVN-Teams am meisten profitieren

Git-Teams haben bereits Zugang zu einer Fülle von Review-Tools. GitHub hat KI-Reviews integriert, GitLab bietet Code Suggestions, und Dutzende von Drittanbieter-Tools ergänzen den Workflow. Für SVN-Teams sieht die Landschaft völlig anders aus: Es gibt kaum moderne, native macOS-Tools mit SVN-Unterstützung, und die Kombination aus SVN-Integration und KI-Code-Review existiert praktisch nicht.

Genau deshalb profitieren SVN-Teams überproportional von einer Lösung wie MaiPed. Sie bekommen nicht nur ein einzelnes Feature, sondern einen kompletten Sprung in modernes Tooling:

- Von keinem Review zu automatischem Review: Der Schritt von „kein Code-Review“ zu „jeder Commit wird von KI gereviewed“ ist ein qualitativer Quantensprung, der die Code-Qualität sofort und messbar verbessert.

- Kein Infrastruktur-Aufwand: Im Gegensatz zu server-basierten Review-Tools braucht MaiPed keinen dedizierten Server, keine Konfiguration und keine Administration. Installieren, Ollama starten, loslegen.

- Datenschutz by Design: Mit lokalen Modellen erfüllt die Lösung automatisch alle Datenschutzanforderungen. Es gibt keine Diskussion mit der Compliance-Abteilung, keine Risikoanalyse für Cloud-Dienste, keine Abstimmung mit dem Datenschutzbeauftragten.

- Kein kultureller Widerstand: Anders als Pull-Request-Workflows, die eine grundlegende Änderung der Arbeitsweise erfordern, integriert sich das KI-Review nahtlos in den bestehenden SVN-Workflow. Commit bleibt Commit – nur mit einem zusätzlichen, optionalen Qualitätsschritt davor.

Fazit: Der richtige Zeitpunkt ist jetzt

Die Kombination aus ausgereiften lokalen KI-Modellen, leistungsfähiger Apple-Hardware und einer nativen SVN-Integration macht 2026 zum idealen Zeitpunkt, um KI-gestützte Code-Reviews in SVN-Workflows einzuführen. Die technischen Hürden sind gefallen: Ollama und LM Studio machen lokale KI zugänglich, Apple Silicon liefert die nötige Rechenleistung, und MaiPed verbindet alles in einem nativen macOS-Workflow.

Für SVN-Teams, die bisher ohne systematische Code-Reviews gearbeitet haben, ist das eine einmalige Gelegenheit: den Sprung zu modernem, KI-gestütztem Qualitätsmanagement zu machen – ohne die Versionskontrolle zu wechseln, ohne die Cloud zu nutzen und ohne den bestehenden Workflow umzukrempeln.

MaiPed bringt zusammen, was zusammengehört: Einen professionellen Dateimanager, vollständige SVN-Integration, KI-gestützte Code-Reviews mit Kategorie-Scores und die Freiheit, alles komplett lokal zu betreiben. Datenschutz ist kein Feature – es ist die Grundlage.

Why SVN Teams Benefit the Most

Git teams already have access to a wealth of review tools. GitHub has integrated AI reviews, GitLab offers Code Suggestions, and dozens of third-party tools complement the workflow. For SVN teams, the landscape looks entirely different: there are hardly any modern, native macOS tools with SVN support, and the combination of SVN integration and AI code review practically does not exist.

That is precisely why SVN teams benefit disproportionately from a solution like MaiPed. They do not just get a single feature but a complete leap into modern tooling:

- From no review to automatic review: The step from no code review to every commit being reviewed by AI is a qualitative quantum leap that immediately and measurably improves code quality.

- No infrastructure overhead: Unlike server-based review tools, MaiPed needs no dedicated server, no configuration, and no administration. Install, start Ollama, get going.

- Privacy by design: With local models, the solution automatically satisfies all privacy requirements. No discussion with the compliance department, no risk analysis for cloud services, no coordination with the data protection officer.

- No cultural resistance: Unlike pull request workflows that require a fundamental change in how people work, AI reviews integrate seamlessly into the existing SVN workflow. A commit remains a commit – just with an additional, optional quality step before it.

Conclusion: The Right Time Is Now

The combination of mature local AI models, powerful Apple hardware, and native SVN integration makes 2026 the ideal time to introduce AI-powered code reviews into SVN workflows. The technical barriers have fallen: Ollama and LM Studio make local AI accessible, Apple Silicon delivers the necessary compute power, and MaiPed connects everything in a native macOS workflow.

For SVN teams that have worked without systematic code reviews until now, this is a unique opportunity: making the leap to modern, AI-powered quality management – without switching version control systems, without using the cloud, and without overhauling the existing workflow.

MaiPed brings together what belongs together: A professional file manager, full SVN integration, AI-powered code reviews with category scores, and the freedom to run everything completely locally. Privacy is not a feature – it is the foundation.